ChatGPT ha ROTO la REALIDAD. ¡Ya no puedes creer lo que ves!

Now Playing

ChatGPT ha ROTO la REALIDAD. ¡Ya no puedes creer lo que ves!

Transcript

623 segments

Open lo ha conseguido. Ya no puedes

fiarte de tus ojos para distinguir qué

es real y que no lo es. No me crees.

Mira esto. Esta es la captura de

pantalla de un canal de YouTube que te

enseña a adiestrar caracoles. Pero si

quieres aprender a hacerlo, tengo una

mala noticia para ti. Este canal no

existe. Esta captura de pantalla ha

generado el último modelo de generación

de imágenes de Open AI. Y como puedes

ver, es alucinante tanto por la

fidelidad con la que recrea la interfaz

YouTube como por la cantidad de textos

que ha renderizado, como por la calidad

de las diferentes imágenes que integran

esta captura. De este modo podemos leer

perfectamente el texto del banner

principal, adiestramiento de caracoles,

su subtítulo, Paciencia, constancia,

muluscos extraordinarios, pero también

textos mucho más pequeños y sutiles de

su interfaz, como por ejemplo la

descripción, el primer canal dedicado al

adiestramiento de caracoles, técnicas,

consejos y entrenamiento, así como las

diferentes pestañas, inicio, vídeos,

shorts, listas, comunidad, los textos de

los ths, el aro, primeros pasos, subir

al podio, así como los títulos. Todos y

cada uno de los detalles encajan

perfectamente, da completamente el pego

y la calidad de los diferentes thoils

también es realmente buena y

perfectamente coherente. Como os decía,

esto lo he generado en Chat GPT con un

prom realmente muy pero que muy

sencillo. Simplemente le he pedido esto.

Crea un screenshot de la página

principal de un canal de YouTube donde

se vean correctamente las diferentes

secciones con los correspondientes

vídeos para un canal de asistento de

caracoles. Y el resultado que ha

generado es este que habéis visto. Y no

es lo único en lo que este modelo

destaca. Fijaros en esta conversación.

Le he proporcionado dos fotografías

mías, una frontal y otra de perfil. Y le

he pedido que generase otras imágenes,

por ejemplo, esta de aquí, donde le pido

que me genere con expresión de sorpresa

y las manos en la cabeza vistiendo un

jersei colorido de rayas. Y este es el

resultado, claramente el mejor resultado

que he conseguido con ningún modelo, sin

necesidad de entrenar ningún lora ni

nada parecido. Este sería un primer

resultado y este sería un segundo

resultado. Este me parece claramente

mejor, pero ambos resultados son mejores

que lo que podemos conseguir con

Nanobanana, que nos permite generar

imágenes como estas de aquí, donde el

parecido es notable, pero claramente por

debajo de lo que conseguimos con este

modelo de Open AI. Y aquí es donde se

abre el debate. El modelo de Open AI es

superior a Nono Banana. Y esto es lo que

vamos a descubrir hoy, porque tengo

preparada una comparativa en

profundidad. Pero antes de pasar a mi

comparativa, merece mucho la pena ver

cómo Open ha presentado este modelo,

porque lo ha hecho de un modo

inmejorable, con una entrada de blog

donde hay mucho que leer, pero donde no

hay ni una sola línea de texto. Todos

son imágenes generadas con este modelo,

el Chat GPT Image 2.0. Y si bien

podríamos ir leyendo el texto que

aparece en las imágenes, creo que lo

mejor es ir haciendo scroll e ir viendo

ejemplos. Ejemplos como este de aquí

donde se ven múltiples interfaces

perfectamente recreadas con texto

renderizado, o este otro que es un

diseño estilo collage perfectamente

funcional o este otro de aquí, una

imagen fotorrealista en este caso de un

puñado de arroz o esta otra, un diseño

editorial perfectamente renderizado.

Incluso podemos ver cómo es capaz de

recrear texto manuscrito. Y si seguimos

bajando, entramos en la parte

multilingüe, cómo es capaz de trabajar

en múltiples idiomas, tanto en ese

ejemplo de la página de cómic como en

esta otra fotografía, donde vemos

portadas de libros escritas en

diferentes idiomas y abecedarios. Y si

bajamos un poco más, encontramos esta

imagen, que es el ejemplo perfecto de

esta capacidad, donde vemos en la parte

central una gran cantidad de texto

renderizado en diferentes idiomas y en

la esquina inferior izquierda vemos el

texto en español que está perfectamente

escrito. Wushi, la perla del lago Taiu,

está ubicada en el sur de Yangu. Tiene

una larga historia y una cultura rica,

por lo que asumo que el resto de textos

también se han renderizado

correctamente. Y si seguimos bajando,

vemos algunos ejemplos más de

tipografía, tal y como podéis ver, pero

llegamos a los ejemplos de fotografías y

podemos ver cómo es capaz de recrear

fotografías hechas con un móvil, también

fotografías de un estilo más

profesional. De hecho, creo que estas

son más sencillas de hacer que las

fotografías que parecen caseras. Podemos

ver como dentro de este tipo de imágenes

puede renderizar texto incluso en

perspectiva. Podemos seguir bajando y lo

que también veremos es cómo es capaz de

generar imágenes tipo diseño gráfico,

cómo es capaz de diseñar, por ejemplo,

pósters y carteles de cine, cómo es

capaz de hacer piñetas de cómic, cómo es

capaz de explicar historias. Y esto es

muy interesante porque ahora ya no solo

podemos hacer que chat GPT nos escriba

una pequeña historia, sino que podemos

dirigirlo para que nos cree, por

ejemplo, un cómic, cómo es capaz de

crear fichas de personaje realmente muy

extensas donde podemos ver sus

diferentes vistas, diferentes

expresiones y cómo incluye la

explicación de cómo es este personaje,

cómo es capaz de manipular diferentes

elementos para que cumplan otra función,

en este caso utilizar alimentos como

tipografía.

Y si seguimos bajando, podemos ver

también elementos interesantes como

este, donde vemos como no solo puede

recrear las diferentes vistas de un

personaje, sino que también puede

recrear las diferentes poses clave de

una animación. Y si seguimos bajando,

podemos ver más ejemplos en diferentes

estilos que realmente funcionan muy

bien, incluso en formatos realmente muy

verticales. Y no solo esto, también es

capaz de generar imágenes que expliquen

conceptos, por ejemplo, en este caso,

matemáticos.

Estamos ante un modelo realmente muy,

pero que muy potente y la única duda es

comprobar si realmente funciona tan bien

como en todos estos ejemplos que os

estoy mostrando. Por lo que a

continuación vamos a ver lo que he

podido generar y lo vamos a comparar con

nanobanana. Y antes de pasar a la

comparativa, un apunte muy importante.

En Chat GPT no puedes conseguir la

máxima calidad que te da este modelo.

Para conseguirla debes recurrir a

herramientas como Freep, que ya ha

incorporado este modelo y nos permite

trabajar con él a máxima calidad.

De hecho, si nos vamos a los selectores

de modelos, podemos ver como en Freepic

tenemos disponibles 42 modelos. Y si

bajamos a la sección donde están los

modelos de Open AI, podemos ver que ya

está disponible el modelo GPT2 y como os

decía, lo podemos utilizar para generar

a máxima calidad. Este es un ejemplo de

ello. Una imagen generada 1024 por 1024

con GPT2 en calidad alta. Y como podéis

ver, todas estas versiones de mí mismo

con los diferentes outfits se parecen a

mí. Cuando quieres generar una imagen

como esta en ChatGPT, el resultado no es

el mismo. Y es que en ChatGPT obtenemos

un resultado como este, un resultado

donde el parecido es razonable, pero ni

de cerca es tan bueno como el que

obtenemos cuando trabajamos con el

modelo trabajando a máxima calidad. Por

lo que Freep, que patrocino el vídeo de

hoy, es una excelente herramienta si

eres un profesional creativo, ya que te

permite acceder a los últimos modelos

disponibles. Como podéis ver, GPT2 ya

está disponible para generar imágenes y

además te da un amplio abanico también

para generar vídeo. De hecho, si nos

vamos a la generación de vídeo y vamos a

ver todos los modelos, podemos ver que

están disponibles los mejores modelos

del mercado. está disponible Sidens 2,

Cling 3, Grock y además hay modelos que

podemos utilizar de modo ilimitado como

con modelo Clean 2.5. ¿Cómo lo podemos

utilizar de modo ilimitado? Pues

contratando su plan Premium Plus. Y es

que si contratamos su plan Premium Plus,

podemos ver como ciertos modelos los

podemos utilizar de modo ilimitado.

Podemos utilizar modelos de generación

de imágenes como el nana banana 2, que

nos permite generar imágenes limitadas a

1K o en el caso de generar vídeo podemos

generar vídeo con el modelo Clean 2.5,

que es un modelo que utilizo

habitualmente en mis vídeos y que

realmente funciona muy pero que muy

bien. Por lo que si necesitas generar

imágenes o vídeo habitualmente, Freepak

es una excelente opción, tanto por

calidad como por precio. encontrarás

toda la información en el enlace de la

descripción. Y ahora sí, vamos allá con

la comparativa entre los dos mejores

modelos de generación de imágenes

disponibles a día de hoy. Nano Banana

versus este Chat GPT Image 2.0. El

primer caso de uso que he puesto a

prueba os lo he mostrado al principio

del vídeo, su capacidad para generar

imágenes de personas a partir de

fotografías de referencia. Y en este

caso, como ya os he dicho, creo que el

modelo de Open AI gana claramente. Esta

es una imagen generada por el modelo de

Openai y esta es la misma imagen

generada por Gémini. Y he hecho otro

experimento haciendo referencia al

estilo de un fotógrafo famoso, como es

el caso de Breson. Y el resultado que he

obtenido con el modelo de Open AI es

este de aquí, que me parece realmente

muy pero que muy bueno y que también es

claramente superior a lo que generó Nano

Banana, por lo que a la hora de trabajar

con referencias de personas, el modelo

de Open se maneja mucho mejor. Pero esta

no es la única prueba que he hecho, por

lo que seguimos. Y la segunda prueba que

he hecho es para constatar su capacidad

para recrear interfaces, capturas de

pantalla y texto dentro de imágenes. Le

he pedido que generase esta imagen de el

sistema operativo de MAC con una página

web abierta y el resultado, como podéis

ver, es simplemente perfecto. Nanobanana

no lo hace mal, pero otra vez diría que

el resultado es inferior. La recreación

del sistema operativo parece bastante

pertinente, pero cuando veo la imagen de

OpenI me parece prácticamente una

captura de pantalla real. Y en el caso

de la imagen que ha generado Nano

Banana, creo que hay detalles que no se

corresponden 100% al Look de Mac, por lo

que en este caso podemos decir que

vuelve a ganar el modelo de Open ahí. E

incluso he ido un poco un paso más allá.

Le he pedido que este tipo de imágenes

me las recreup,

que este era un tipo de trabajo que

hacíamos muy a menudo hace unos años

donde pues creábamos ese tipo de

imágenes, cre diseñábamos una página web

y la teníamos que contextualizar y la

verdad es que el modelo de OpenI también

hace un trabajo excelente. La verdad es

que la Novanana también es perfectamente

funcional para hacer este tipo de

imágenes y el resultado que obtenemos

con él es algo como este. Pero las

imágenes pues lcen como más saturadas y

hay alguna aspecto en la textura que me

parece menos realista. Aquí no sabría

exactamente cómo decirlo, pero me parece

menos realista que el resultado que

obtenemos con el modelo de Openi. Por lo

que en este segundo caso de uso diría

que también gana el nuevo Chat GPT Image

2.0. Y por cómo ha empezado esto,

seguramente estaréis pensando que el

modelo de Open AI va a ganar por

goleada, pero no. Hay algunos casos de

uso donde Nanobanana aún rinde mejor.

Por ejemplo, le he pasado esta imagen de

una planta de un piso y le he pedido a

ambos modelos que la rendericen en una

vista pues tridimensional. Y lo que ha

hecho OpenI en este caso es algo peor

que lo que ha hecho el modelo de

nanobanana. ¿Por qué? Porque fijaros, me

ha hecho esta imagen, que de hecho

respeta muy bien la estructura del plano

original, pero hay detalles que los ha

alucinado. Por ejemplo, la barra de la

cocina, pues está separada de la mesa

con estos taburetes y luego la mesa para

comer. Y si os fijáis en el plano

original estaban pues juntas,

perfectamente pegadas. También ha

alucinado como un recobeco en la barra

de la cocina que no debería existir. Y

en general, si nos vamos fijando en

detallitos, pues vemos cómo ha decidido

pues reinterpretar algunos elementos.

Por ejemplo, la cama tampoco es igual.

El lavabo también tiene algún detallito

que no se corresponde con cómo está

diseñado en el plano y en cambio, en

este caso, el modelo de Google lo ha

hecho sensiblemente mejor y se ha

limitado a renderizarlo casi todo tal

cual está. No es perfecto tampoco, pero

por ejemplo los detalles que os he

mostrado antes los ha hecho mejor. Sí

que es verdad que al ser una habistación

y tal ha cometido algunos errores de

razonamiento, de interpretación, por

ejemplo, levantando esta pared aquí en

la cocina que ha considerado que estaba

separada y que no era una cocina

abierta, que aquí podemos ver que según

el plano debería haber sido una cocina

abierta, pero a la hora de representar

eh en su sitio cada uno de los

elementos, pues el modelo de Google ha

sido más estricto.

Seguimos con otro caso de uso. ¿Cuál de

los dos es mejor a la hora de convertir,

por ejemplo, una ilustración en la

fotografía que podría haber inspirado

esta ilustración? Pues bien, el

resultado que obtenemos con el modelo de

OpenI es este de aquí, que es un

resultado realmente muy pero que muy

bueno, donde pese a que la ilustración

tiene unas proporciones imposibles, como

podéis ver la cabeza es realmente muy

grande, las piernas también son como un

poco cortas y por lo tanto si lo que

queremos es recrear la fotografía que

inspiró esta imagen, pues tenemos que

recrear una imagen donde la niña tenga

unas proporciones normales.

Pues bien, en este caso, el resultado

que nos ha dado Chat GPT me parece

claramente superior también al que nos

dio Nano Banana. Fijaros, esta es la

misma imagen de referencia. Y cuando nos

vamos a la imagen que ha generado para

crear la fotografía que la inspiró, como

podéis ver, nos ha generado una niña con

un brazo muy largo, con una cabeza muy

grande, con unas piernas muy cortas, por

lo que en este ejemplo vuelve a ganar

claramente el moment el modelo de OpenI.

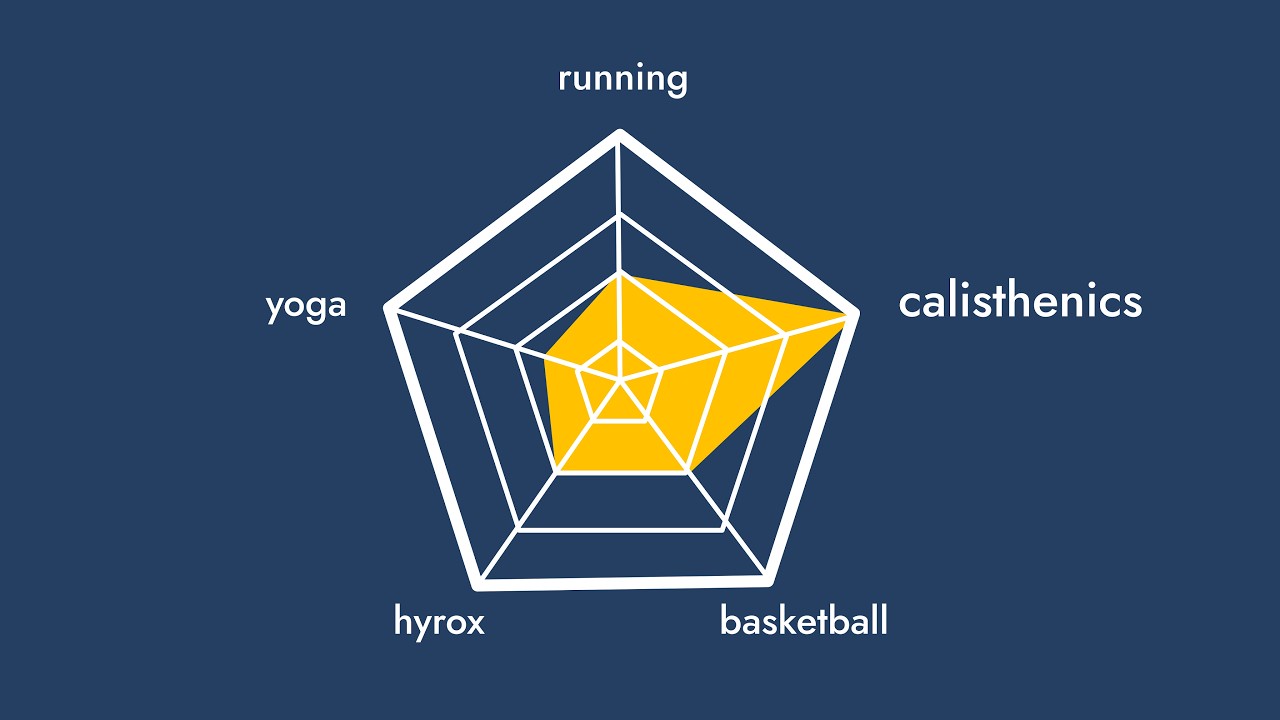

Y ahora vamos al siguiente ejemplo donde

quiero constatar cuál de los dos es

mejor a la hora de generar imágenes que

transmitan información, esencialmente

infografías. Pues bien, en el primer

ejemplo, además de darle un prom, le he

pasado dos imágenes de referencia, esta

y esta, y le he pedido que las incluya

dentro de la infografía final, que lo

que tiene que hacer, pues es explicar eh

stonehedge. Pues bien, el resultado que

hemos conseguido es un resultado como

este y la verdad es que es un resultado

muy pero que muy bueno, al menos a nivel

visual, a nivel de cómo ha ido marcando

los diferentes elementos. Habría que ver

si es correcto al 100%, pero al menos sí

que es verdad que ha renderizado muy

bien los textos, que ha introducido

bastante texto, que ha introducido una

cronología y que por la vista entra. Si

esto me lo encuentro en una revista tipo

National Geographic, pues creo que me

colaría bastante bien. ¿Qué tal lo hizo

Nano Banana? Pues la verdad es que en

esto ya sabemos que noana también es muy

muy bueno, pero la verdad es que el

resultado en este caso pues no me

convence tanto como lo que ha hecho

Opení, es decir, visualmente es bastante

más feo. Sí que renderizó bastante bien

prácticamente todo el texto. Creo que no

hay errores de bulto, pero sí que es

verdad que a nivel visual, a nivel de

decisiones de diseño, como estas letras

en vertical, pues el resultado me parece

inferior también al del nuevo modelo de

Openi. Y ahora vamos con un segundo

ejemplo de esta categoría, donde la

verdad el veredicto no lo tengo tan

claro. En este caso, mejor que me dejéis

en los comentarios y me ayudéis a decir

un poco. Y es que los dos lo hicieron

muy bien. Aquí digamos que quise rizar

un poco el rizo con el tipo de

infografía que quería que me generase y

lo que le pedí es que me generase una

infografía del ciclo del agua, que

explicase el ciclo del agua como una

fotografía a una maqueta hecha por niños

y anotada con texto escrito con

tipografía manual. Y la verdad es que lo

que ha generado el modelo de Open AI se

ajusta perfectamente a la instrucción

que le he pedido. Tenemos una maqueta y

la tenemos anotada con tipografía manual

y la explica perfectamente el ciclo del

agua. El modelo de Open también ha hecho

un trabajo muy bueno, pero la verdad es

que si tenemos en cuenta que yo le he

pedido que generase una maqueta hecha

por niños con elementos de papel y otros

elementos caseros como materiales

reciclados, pues la verdad es que la

maqueta del modelo de Open AI me parece

bastante más ajustada a esta

instrucción. Luego las anotaciones no

están en tipografía, no están como

hechas encima de la imagen, me las ha

puesto directamente como postit, pero

diría que en general se ha adecuado

mejor a la instrucción, en este caso, el

modelo de Google que el de Open la

verdad es que esta es una imagen

estéticamente mejor, pero es que en este

caso no le he pedido que me generase una

maqueta bonita, le he pedido que me

generase una maqueta que hubiesen podido

hacer niños y en este caso pues esta me

parece que se ajusta mejor. Bueno, como

os digo, aquí no tengo ganador claro,

por lo que si en los comentarios me

ayudáis a decir cuál de las dos es

mejor, pues ideal. Y este último ejemplo

me ha hecho reflexionar sobre una

característica fundamental de cualquier

modelo, no solo de los modelos que

generan imágenes, cómo es su capacidad

para adecuarse al prom, por lo que me he

propuesto hacer un experimento que

consistía en pedirle algo extraño al

modelo. ¿Cómo era el hecho de generar

tres elementos, e ordenarlos o pedirle

que ponga números a su lado que no fuese

el orden lógico y que estos elementos

tampoco tuviesen el color característico

que deberían tener. Esencialmente lo que

le he pedido y para ir al grano es lo

siguiente. Le he pedido que me genere un

plátano azul, que es lo que el primer

elemento que tenía que aparecer a la

izquierda con el número romano dos,

justo a su lado. Le he pedido que

generase una manzana morada con el

número tres a su lado que debía aparecer

en medio, y le he pedido que generase

una naranja, no naranja, sino de color

rosa y con el número uno al lado y que

además encima de estas tres frutas

apareciese el texto Roman Fruit y que

todo esto se reflejase en una superficie

reflectante tipo espejo. Y fijaros, en

este caso el modelo de OpenI ha sido

capaz de hacerlo sin ningún tipo de

problema. Podemos ver como ha generado

el plátano azul con el dos al lado, la

manzana morada con el tres al lado, la

naranja rosa con el uno al lado, Roman

Fruid encima y cómo ha sido capaz de

reflejar esto sin ningún tipo de

problema. decir en este caso que el

modelo de Google pues también ha sido

capaz de hacerlo perfectamente, por lo

que con prom esta complejidad ambos

modelos se manejan bien, por lo que de

momento el modelo de Google solo ha

ganado en uno de los emparejamientos,

pero no se va a quedar solo a uno el

tanteo. En este ejemplo de aquí ha

vuelto a ganar el modelo de Google. Le

he pedido esencialmente que coja todos

estos elementos de esta habitación, lo

analice y me ordene la habitación. Y el

modelo de Open AI me ha generado esta

imagen de aquí donde claramente faltan

elementos y además alguno de los

elementos aparece roto. Este avión no

tiene ningún tipo de sentido. Y aquí

podéis ver los todos los elementos que

aparecían. El modo de Google obviamente

no me lo ha hecho perfecto porque hay un

montón de elementos, pero la verdad es

que la imagen resultante, pasándole

exactamente a la misma imagen, me parece

bastante más lógica y coherente. Aquí

podéis ver el resultado, por lo que en

este caso concreto ha vuelto a ganar el

modelo de Google. Y llegamos al último

ejemplo. Este ejemplo ya iba con una

instrucción que no estaba tan enfocada a

ver si era capaz de generar una imagen

respetando todos los elementos que

aparecen al prom ni la calidad de la

imagen en sí, sino en interpretar un

prom para crear una historia. Y la

verdad es que el resultado me ha

sorprendido bastante. Lo que le he

pedido es lo siguiente. Genera un cómic

de cuatro viñetas con una alta dosis de

sarcasmo y mala leche sobre el potencial

impacto de la evolución de la

inteligencia artificial de generación de

imagen y vídeo en la industria

audiovisual. El texto que aparezca debe

ser en español. El estilo debe ser de

cómic europeo de los 80. Y fijaros lo

que ha generado. Me ha generado esto. La

primera viñeta dice, "Tranquilos, la

inteligencia artificial no nos va a

quitar el trabajo. Va a hacerlo mejor,

más rápido, más barato y sin quejarse.

Aquí la ironía ya está un poco

implícita. En la segunda viñeta dice,

"Pronto cualquiera con un ordenador y la

imaginación de un pepino podrá hacer una

película épica." Bueno, se ve como un

prom y genera. Adiós. Años de estudio,

noches en vela, equipos gigantes, egos

frágiles y sueldos de Ahora

basta con pegar y generar el arte

democratizando la mediocridad también. Y

aquí en el fondo unos que dicen, "Era

bueno, pero caro." Y todos los textos

que aparecen dentro de la imagen, más

allá de los diálogos, van un poco en la

misma línea. Aquí ya hace el cine hecho

con pasión y dignidad. Presupuesto 0 €.

Resultado, ¿quién sabe? Y termina con

esto. Pero tranquilos, siempre nos

quedará el consuelo de decir con aire

superior. Yo hacía antes, yo lo hacía

antes de que fuera fácil y de que lo

hiciera cualquiera con dos neuronas y

una tarjeta gráfica. Y en el fin pone de

una época que ya olía mal. Y este

letrero al final, la inteligencia

artificial no tiene alma, pero tiene

mejor iluminación, mejor edición y no

pide vacaciones. A simple vista, cuando

lo he leído, me parecía como muy

literal, pero luego cuando le he dado

otro vistazo, realmente me parece un muy

buen resultado. ¿Mejor o peor que el de

Gémini? La verdad es que me parecen

ambos dos muy buenos resultados. El de

Gemi no es tan denso en texto y quizá en

el fondo tenga un poco menos de mala

leche, aunque el concepto me parece

quizá un poco más interesante y mejor

ejecutado. Año 2023, la IA es nuestro

copiloto. Qué útil me ahorra me ahorra

pintar fondos. Año 2025, ahora genera

todo la película entera. Yo solo le

sugiero que añada explosiones. Año 2028.

gran creador me llaman, tú ahora te

dedicas a limpiar mis ventiladores y que

al final terminamos simplemente eh

viendo contenido generado por la IA un

poco lobotomizados. El mensaje de este

quizá me parece más potente, pero la

verdad es que los diálogos y cómo ha eh

hilado las cuatro viñetas el modelo de

Open AI también me parece muy muy bueno,

por lo que aquí lo voy a dejar en un

empate. Dicho esto, ¿qué os ha parecido

esta comparativa? ¿Qué os ha parecido el

modelo? Decidme qué os parece a vosotros

si lo probáis realmente, porque ya está

disponible en chat GPT. Y yo solo

deciros que realmente me ha sorprendido,

sobre todo, la calidad y la textura de

las imágenes, porque realmente llega un

momento en que lo que estás viendo

parecen realmente imágenes reales. Creo

que ahora sí ya podemos decir que hemos

cruzado el umbral donde un modelo

disponible para todo el mundo sin

necesidad de recurrir a técnicas

complejas como loras y entrenamientos

específicos para terminar de optimizar

el modelo para crear cierto tipo de

imágenes y es capaz de crear imágenes

absolutamente indistinguibles de la

realidad. Y esto es una gran oportunidad

para muchos sectores profesionales, pero

también es una amenaza considerable a la

hora de difundir información. Dicho

esto, si quieres seguir aprendiendo

sobre generación de imagen y vídeo, te

recomiendo el siguiente vídeo y nosotros

nos vemos en el próximo vídeo.

Interactive Summary

Ask follow-up questions or revisit key timestamps.

Este video explora las nuevas capacidades del modelo de generación de imágenes de OpenAI, destacando su habilidad superior para renderizar texto coherente, crear interfaces realistas y generar imágenes a partir de fotografías de referencia sin entrenamiento adicional. El creador compara este modelo con Nano Banana a través de varios casos de uso, incluyendo la creación de infografías, recreación de planos y generación de cómics, concluyendo que aunque el modelo de OpenAI es generalmente superior en calidad visual y realismo, todavía existen áreas donde otros modelos pueden ofrecer resultados más precisos.

Suggested questions

3 ready-made promptsRecently Distilled

Videos recently processed by our community